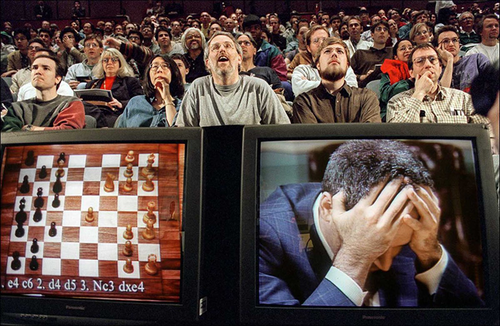

11 maggio 1997, New York. Dopo sei match di competizione febbrile di fronte alla scacchiera, l’allora più grande giocatore di scacchi di tutti i tempi, Garry Kasparov, si arrende. A batterlo è un giocatore capace di valutare 200 milioni di mosse al secondo: il programma DeepBlue della IBM, un’intelligenza profondamente specializzata sull’unico obiettivo di vincere a scacchi.

La carriera scacchistica di Garry Kasparov non si interrompe però con una resa incondizionata al nuovo avversario virtuale, né con un’amarezza luddista: l’anno successivo, Kasparov ha l’intuizione di creare una squadra uomo-computer per competizioni di scacchi. Nasce così Advanced Chess: giocatori umani e virtuali, con i loro specifici punti di forza e le inevitabili debolezze, non stanno più al lato opposto della scacchiera, ma cooperano come un nuovo giocatore ibrido, detto cyborg o centauro.

L’Intelligenza Ibrida

Questo è il principio dell’intelligenza ibrida: creare sinergia fra l’intelligenza umana e l’intelligenza artificiale, dando vita a un risultato superiore alla somma delle proprie parti, capace di raggiungere obiettivi impensabili singolarmente sia per l’IA, che per noi.

L’imperativo è aumentare, anziché sostituire, l’intelligenza umana. L’intelligenza artificiale non assume quindi l’aspetto del lavoratore instancabile volto a rimpiazzare l’uomo in ogni sua mansione, ma viene considerata uno strumento comparabile a ciò che nel corso dei secoli sono stati il fuoco, la ruota, la stampa, poi il computer e Internet: una tecnologia abilitante, capace di espandere i nostri orizzonti su cosa è possibile, e permetterci di agire, produrre e imparare su di una scala prima impensabile.

Una conferenza (e una community) multidisciplinare

Questi sono gli argomenti e le sfide investigati nel corso della conferenza Hybrid-Human Artificial Intelligence (HHAI), tenutasi ad Amsterdam dal 13 al 18 giugno 2022 presso la Vrije Universiteit. Una prima edizione di quella che si prospetta essere una lunga serie, organizzata dall’olandese Hybrid Intelligence Center e dal network europeo HumaneAI.

Il pubblico di riferimento è variegato, per favorire la nascita di una community capace di generare nuove idee sugli aspetti etici, tecnici, legali, sociali e cognitivi della collaborazione uomo-AI. Di fronte a questa diversità di profili e percorsi, gli immancabili espresso, latte o Americano pre-conferenza diventano forieri di collaborazioni interdisciplinari, e i tavolini della colazione si fanno teatro di scambi di promesse su paper o prototipi da realizzare assieme.

La rassegna è stata inaugurata da due giorni di workshop, eventi dall’approccio fortemente interattivo dove confrontarsi con gli altri partecipanti in un contesto semi-informale, dove intervenire è la regola e il successo si misura in nuove idee generate. I workshop sono stati un’occasione di apprendimento unica, dove spaziare dall’avanzare ipotesi sul futuro dell’intelligenza artificiale post-AI Act europeo al lavorare in team per esporre le criticità dei sistemi di giustizia predittiva, dal seguire esposizioni sugli aspetti più controversi della robotica sociale e dei diritti dei robot all’imparare ad adottare una prospettiva socio-tecnica e socio-ecologica nella valutazione dell’impatto dell’intelligenza artificiale.

La conferenza vera e propria – quella con aula magna gremita, palcoscenico, luce a occhio di bue e microfono – è stata animata da trentatré presentazioni di paper, quattro keynote speaker e una poster session. Molti degli interventi sono stati ispirati dalla prospettiva di un’intelligenza artificiale incentrata sulle effettive necessità e capacità cognitive umane, lontana dal paradigma dell’evoluzione ad ogni costo. Bart van Leeuwen, vincitore del premio per il miglior paper breve, ha fatto riferimento alla sua esperienza da pompiere per sottolineare la necessità di tutelare la consapevolezza situazionale degli utenti, ossia la capacità di percepire e reagire, autonomamente ed efficacemente, agli stimoli esterni. Questa qualità, essenziale in contesti ad alto rischio e dai ritmi serrati, rischia di essere ovattata dal sovraccarico informativo dato da applicazioni di intelligenza artificiale usate per procedure di analisi in situazioni di crisi, capaci sia di fornire informazioni cruciali che provocare pericolose distrazioni.

“Devi comunque giocare bene a scacchi”

In sintesi, l’integrazione dell’IA nei processi decisionali non può avvenire a discapito del senso critico e delle capacità umane: questo è stato l’argomento affrontato anche dal paper che ho presentato in questa sede.

Open, Multiple, Adjunct. Decision Support at the Time of Relational AI (disponibile qui per la lettura e il download), scritto con il Prof. Federico Cabitza, è incentrato attorno a una domanda: come fare in modo che l’IA posso aumentare, piuttosto che atrofizzare, la nostra autonomia, intuizione e senso di responsabilità nei processi decisionali?

È necessario ripensare, attraverso specifiche soluzioni di design, le scorciatoie cognitive che ci vengono offerte da questi sistemi. Il rischio è quello di sviluppare una vera e propria atrofia decisionale: un senso di compiacimento e acriticità verso i risultati che ci vengono forniti automaticamente dall’IA, fino allo sviluppo di un vero e proprio bias cognitivo – l’automation bias – che dà preponderanza all’output artificiale piuttosto che all’intuizione umana, anche in casi di assoluta incompatibilità ed evidente errore.

La soluzione non è lo strenuo aumento della potenza computazionale, con lo scopo di raggiungere una tecnologia teoricamente infallibile: la capacità di calcolo è solo uno dei fattori che determina la qualità del risultato finale. La legge di Kasparov, dedicata proprio a questo argomento, è lapidaria: a fare la differenza è il processo di cooperazione uomo-AI, capace di superare anche le limitazioni di conoscenza umana o di potenza computazionale. Un processo dove la componente (e competenza) umana non può essere messa da parte.

Il Gran Maestro di scacchi e centauro Viswanathan Anand, vincitore di tre tornei consecutivi di Advanced Chess nel 1999, 2000 e 2001, ha esemplificato limpidamente questa preoccupazione. In seguito alla sua sconfitta nel 2002 contro Vladimir Kramnik, Anand ha affermato: “Credo che in generale le persone tendano a sovrastimare l’importanza del computer nelle competizioni. Puoi fare molte cose con il computer, ma devi comunque giocare bene a scacchi.”

La concezione ibrida dell’intelligenza, con la sua enfasi sulla complementarietà e insostituibilità fra uomo e IA, può fornirci gli strumenti teorici e pratici per dare preponderanza allo sviluppo e tutela delle facoltà umane. Il percorso da intraprendere richiederà una prospettiva multidisciplinare sullo studio e sostegno delle capacità cognitive, socio-emotive ed etiche dell'uomo, e la loro interazione con l'intelligenza artificiale negli ambiti di decisione, autonomia e responsabilità.